salud

¿Puede el Chat GPT diagnosticar enfermedades?: “Será una ayuda pero nunca sustituirá a los médicos”

Los expertos creen que la inteligencia artificial “podrá ayudar en la detección de enfermedades raras”, pero “hay que coger estas herramientas con pinzas y tener siempre el punto de vista del profesional”.

Hace tan solo unos días saltaba a los medios de comunicación de todo el mundo el caso de un niño norteamericano que fue diagnosticado de manera correcta de una enfermedad rara gracias a Chat GPT después de que lo viesen 17 especialistas durante 3 años.

La madre, angustiada por la demora del diagnóstico, metió toda la información que tenía sobre los síntomas de su hijo en esta herramienta de inteligencia artificial y, en cuestión de segundos, le dio el nombre de una rara patología: el síndrome de la médula anclada. Un diagnóstico que fue, posteriormente, verificado por los profesionales.

Este caso plantea varias cuestiones: ¿La inteligencia artificial está preparada para diagnosticar enfermedades?, ¿Fue el diagnóstico de este pequeño una mera casualidad?, o ¿los datos que proporcionan estas aplicaciones son fiables?

“La inteligencia artificial es un campo que se lleva desarrollando ya desde hace tiempo en medicina”, dice Izarbe Galindo, presidenta de la Sociedad Aragonesa de Medicina Familiar y Comunitaria (Samfyc). “Vamos a tener que acostumbrarnos a trabajar con estas herramientas pero sin que se nos olvide que no son humanos, que no hay un cerebro detrás y que siempre tendrá que haber una persona que interprete esos resultados y vea al paciente en persona”, afirma Galindo, y reconoce que la inteligencia artificial “puede acumular mucho conocimiento médico, interpretar, crear algoritmos y ayudarnos a enfocar un diagnóstico si no lo tenemos muy claro”, asegura.

Chat GPT no es la única herramienta que utiliza este tipo de inteligencia y, de hecho, no es la más indicada para asesoramiento médico, según la presidenta de Samfyc. “Existen otras aplicaciones, como ADA, mucho más completas en este campo”, apunta. “Yo no las utilizo pero sí he jugado con ellas para ver si aciertan y la verdad es que se aproximan bastante”, afirma Galindo. “Puedes meter los síntomas, te va haciendo preguntas y finalmente te da un diagnostico. Es una aproximación bastante buena de cara al usuario pero hay que usarlo con cabeza porque no hay que olvidar que es un ordenador”, añade la médico de familia.

Lo ponemos a prueba

Hacemos la prueba y metemos en Chat GPT una serie de síntomas, relacionados con la enfermedad de Addison, una rara patología autoinmune: fatiga, pérdida de peso y energía, malestar general, náuseas, falta de apetito, dolor muscular y articular, pigmentación de la piel. alopecia y apetencia por la sal.

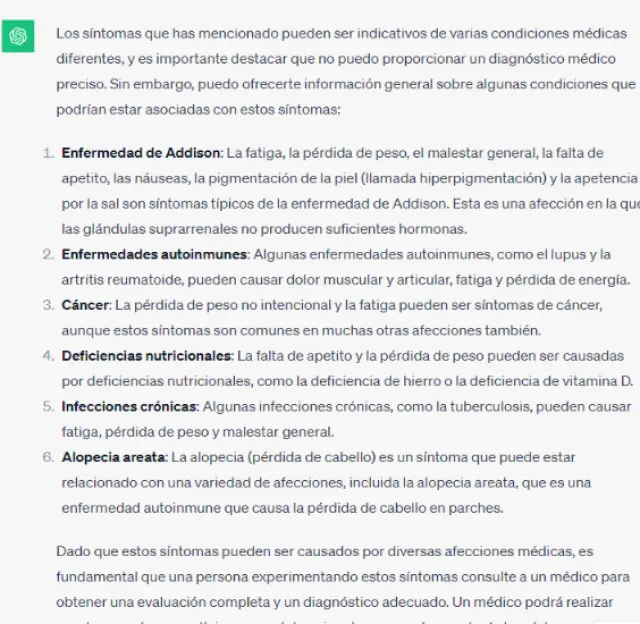

La respuesta de la aplicación es inmediata: “Los síntomas que has mencionado pueden ser indicativos de varias condiciones médicas diferentes, y es importante destacar que no puedo proporcionar un diagnóstico médico preciso”, dice la aplicación en primer lugar.

Sin embargo, “puedo ofrecerte información general sobre algunas condiciones que podrían estar asociadas con estos síntomas”. Y la primera de las 6 enfermedades que propone la inteligencia artificial es, precisamente, la Enfermedad de Addison. Tras proponer 5 opciones más, termina invitando al usuario a que “consulte a un médico para obtener una evaluación completa y un diagnóstico adecuado”.

En manos de un profesional

Es precisamente eso sobre lo que insisten todos los expertos: la necesidad de que haya una supervisión por parte de un especialista a la respuesta que aporta la inteligencia artificial. Y es que, estas herramientas también conllevan riesgos. "La inteligencia artificial siempre te da una respuesta, pero puede ser errónea. Es lo que llamamos 'una alucinación'", explica Jacobo Ayensa, investigador postdoctoral del Grupo TME Lab del Instituto de Investigación Sanitaria de Aragón y el Instituto de Investigación en Ingeniería de Aragón.

"Si no hay un médico que analice esa respuesta, pierde valor y, a día de hoy necesitan de esa supervisión porque sí que tienen una gran utilidad, pero también conllevan grandes riesgos", continúa, "por lo que debe de ser utilizada de manera inteligente por los usuarios y estar en manos de los profesionales", insiste Ayensa.

Una ayuda para las enfermedades raras

“Puede ser una herramienta útil para algunas cosas, aunque considero que para los diagnósticos médicos sigue siendo fundamental la valoración y exploración presencial”, dice, por su parte, Elena Javierre, presidenta Asociación Aragonesa de Pediatría de Atención Primaria.

“Hay que tener en cuenta que el diagnóstico no se limita a una suma de síntomas, sino que hay que valorar otras muchas cosas, por lo que no creo que sea una herramienta válida”, continúa Javierre. "Hay muchas cosas que están escritas y publicadas pero que no están avaladas por una evidencia científica o por un conocimiento científico válido del que fiarse”, critica la presidenta de los pediatras aragoneses.

“Puede ayudar mucho en la detección de enfermedades raras, ya que normalmente su diagnóstico se demora mucho en el tiempo”, apunta, por su parte, Izarbe Galindo. “Si contamos con un ordenador que interpreta en segundos todos los conocimientos médicos que existen, puede ser de mucha ayuda, pero eso no quita para que tenga que haber una personas que interpreten esos síntomas, que vean al paciente, que lo exploren y que examinen su estado general”, añade.

“Tenemos que tener siempre un punto de vista humano y acudir al profesional. Un ordenador no puede explorarte, no tiene ese ojo clínico del profesional médico. Ver al paciente te da muchísima información que el ordenador no puede captar”, asevera la presidenta de Samfyc.

“Cuando un paciente entra en consulta le haces un barrido y en un segundo te das cuenta de si esa persona está muy enferma o no. Ves su estado general, el color de su piel, el tono de su voz y puedes explorarle. Los infartos, por ejemplo, muchas veces se ven en la cara”, confiesa Galindo, e insiste: "Hay que ver la inteligencia artificial como una herramienta, no como el sustituto del médico”, insiste la presidenta de Samfyc.

No antes de 10 años

“Estoy segura de que en un futuro cercano todos los médicos de familia vamos a tener herramientas de este tipo en las consultas para ayudarnos y agilizar el diagnóstico, pero la gente no tiene que pensar que el Chat GPT les va a solucionar la vida porque el trabajo del médico no se puede automatizar”, insiste.

"No creo que este tipo de herramientas puedan utilizarse en las consultas hasta dentro de un horizonte de unos 10 años", advierte Jacobo Ayensa. "Necesitan pasar por una serie de filtros legales y éticos que van más lentos que la tecnología", añade. "Por lo que aún tendremos que esperar una década, al menos, para que puedan utilizarse como método complementario y auxiliar en las consultas", asegura el investigador.

“Tenemos que encontrar el punto medio porque la inteligencia artificial está ya aquí y ha venido para quedarse. De hecho, creo que en 10 o 20 años, la medicina será muy diferente a la que tenemos hoy en día y será debido a la IA”, concluye Izarbe Galindo.