Científicos y pacientes avisan: cada vez cuesta más distinguir contenidos reales en salud

El uso de la inteligencia artificial en salud supone un gran riesgo de desinformación.

Sociedades científicas, asociaciones de pacientes y organizaciones del ámbito hospitalario han reclamado este martes a las empresas que desarrollan inteligencia artificial en salud un compromiso ético porque, advierten, cada vez es más difícil distinguir los contenidos reales de los falsos.

La Asociación de Innovadores en eSalud (Aies), la red Itemas (dependiente del Instituto de Salud Carlos III) y el Instituto #SaludsinBulos han lanzado esta demanda en el simposio 'Hackeando la Sanidad: Inteligencia Artificial en Salud' para evitar los riesgos de confidencialidad de los datos de los pacientes y desinformación que ha conllevado el uso de la IA.

El uso de la inteligencia artificial en salud reducirá la carga de trabajo de los profesionales sanitarios, de hasta aun 20 % a los médicos y un 8 % a las enfermeras, lo cual redundaría en el tiempo que puedan dedicar a los pacientes, reconocen los autores de la iniciativa, a la que ya se han sumado sociedades de Atención Primaria como semFYC y Semergen y la de enfermería Feacap.

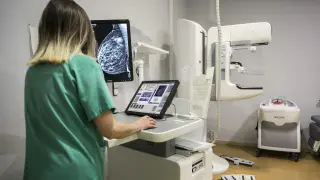

"Diversos estudios han demostrado que muchos de los diagnósticos que realiza la IA son más precisos que los que puede realizar cualquier equipo médico. También está ayudando a asignar mejor los recursos de la asistencia sanitaria y a realizar tratamientos más personalizados", ha señalado la doctora Carmen Jódar, responsable de estrategia digital en la Junta de Andalucía y presidenta de Aies.

Pero también supone un riesgo de desinformación en salud, como están mostrando los "deep fakes" -vídeos con imágenes creadas por Inteligencia Artificial, incluso de personas reales cuya imagen y voz son manipuladas-, de modo que cada vez va a ser más difícil distinguir entre lo que es un contenido real de otro falso.

Ya está ocurriendo con ChatGPT y la Inteligencia Artificial Generativa, ha añadido Carlos Mateos, coordinador del Instituto #SaludsinBulos y del Hackathon Salud, organizado con el objetivo de impulsar soluciones basadas en la IA que ayuden a combatir la desinformación.

Lluís Blanch, coordinador de Itemas, ha considerado que la IA "debe formar parte de las soluciones tecnológicas que ayuden a la asistencia sanitaria", como las que ya se aplican en algunos centros para los diagnósticos en urgencias o en el campo de la medicina personalizada.

Pero es necesario impulsar un compromiso ético que minimice los riesgos y se sustente en garantizar la autonomía, el bienestar del paciente, la confiabilidad, la equidad, la información veraz, la privacidad, la representatividad, la responsabilidad, la sostenibilidad y la transparencia.