Tercer Milenio

En colaboración con ITA

Innovación

Una mesa sensorial desarrollada en Aragón ha creado el primer algoritmo que detecta las emociones de gente comiendo

Con tecnología de inteligencia artificial y equipada con una cámara 360º, detecta y analiza las emociones al degustar los platos.

Al comer hacemos un montón de gestos que no le ponen fácil a una inteligencia artificial determinar si masticamos o estamos enfadados. Una mesa sensorial desarrollada en Aragón ha creado el primer algoritmo de detección de emociones para gente comiendo del mundo. Esta novedosa herramienta puede ayudar a los restaurantes a acertar con su oferta gastronómica y la presentación de sus platos.

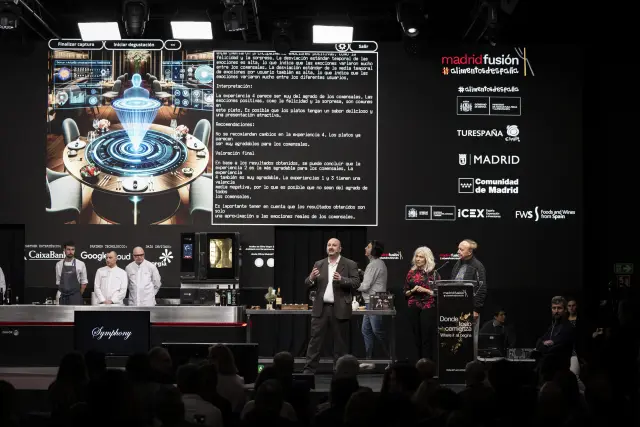

El restaurante Gente Rara de Zaragoza ha sido el primero en ayudarse de esta mesa sensorial de detección de emociones para, de la mano de la ciencia, decidir cuál es la mejor manera de presentar sus platos. Desarrollada por el Instituto Tecnológico de Aragón en colaboración con el Centro de Innovación Gastronómica de Aragón y la Asociación Provincial de Empresarios de Hostelería y Turismo de Huesca, se presentó por todo lo alto en la última edición de Madrid Fusión.

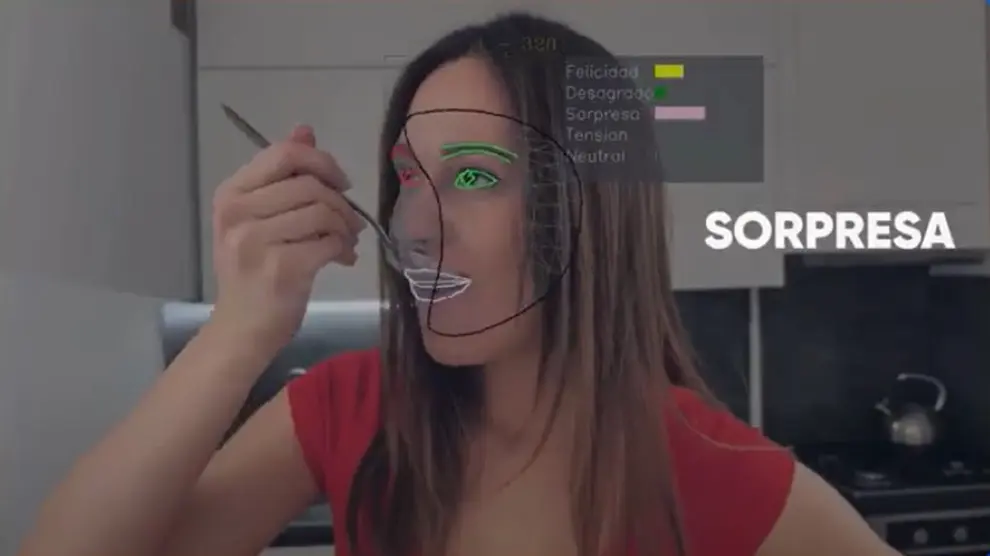

Desde el centro de la mesa, una cámara 360º no pierde detalle y captura las reacciones de los comensales durante toda la experiencia gastronómica, desde las explicaciones previas del chef a la degustación de platos. Esta innovadora herramienta utiliza la inteligencia artificial para interpretar las reacciones emocionales de los clientes, escritas en sus rostros. Las gráficas resultantes pueden ayudar a los restaurantes a acertar con su oferta gastronómica.

"Nuestro objetivo no es decir si un plato es mejor que otro, pues el gusto es un concepto muy personal, sino cuantificar las emociones detectadas", advierte Rafael del Hoyo, coordinador tecnológico del departamento de Inteligencia Artificial (IA) del Instituto Tecnológico de Aragón. "La chef o el chef puede diseñar un plato buscando que despierte más sorpresa, felicidad o tensión y comprobar, gracias a la herramienta, si ha cumplido las expectativas", expone.

El primero del mundo

No duda al resaltar lo más novedoso: "Hemos creado el primer algoritmo de detección de emociones para gente comiendo del mundo". Explica que, aunque estamos viviendo el boom de la IA y en los últimos años se ha venido aplicando al reconocimiento de emociones, la tarea de detectar emociones durante la comida no se había abordado. El principal motivo es "porque comer implica una serie de gestos y muecas con la cara (abrir la boca para introducir la comida, masticar, mirar hacia abajo al plato, tragar…) que dificultan enormemente esta tarea". Por ejemplo, al masticar apretamos los dientes, pero no es porque estemos enfadados. Evitar estas confusiones les ha llevado a tener que entrenar los modelos específicamente para ignorar o entender el motivo de estas muecas.

La intención final es que "la mesa sensorial lleve la estadística a los restaurantes", indica Del Hoyo. El resto del equipo, compuesto por Gorka Labata, José Ignacio Calvo, Marcos Caballero y Estela Aguilar, pone un ejemplo ilustrativo: "Supongamos que un determinado establecimiento está muy satisfecho con uno de sus platos, pero contiene un ingrediente que es caro y difícil de conseguir, por lo que les gustaría sustituirlo sin que repercuta demasiado en el resultado final". El análisis estadístico que genera esta herramienta "permitiría determinar las emociones que despierta el plato en clientes de prueba tanto con el ingrediente como con su sustituto y comparar".

Como la herramienta genera informes en tiempo real, un chef podría saber sobre la marcha cómo están funcionando sus platos en la sala. "Detectaría si un día las lentejas han quedado saladas y podría dejar de ofrecer el plato hasta que resolver el problema", señalan.

Salir del laboratorio

El desarrollo de la mesa ha sido un proceso intenso a lo largo de más de un año. "Nuestro objetivo era llegar a la comunidad gastronómica y Madrid Fusión, el evento indicado, así que hemos trabajado contrarreloj", recuerdan. Para lograrlo han trabajado estrechamente con varios restaurantes de Aragón –especialmente el Callizo, Yain y Gente Rara–, "para que nos aconsejasen e incorporar su visión como expertos". Están contentos con el interés despertado. "Es hora de que la herramienta abandone el laboratorio y empiece a probarse en los restaurantes que crean que es interesante".

Una base de datos que sabe a guindillas con chucrut remojadas en aceite de coco

"Ha sido muy duro tener que comer guindillas con chucrut remojadas en aceite de coco". Lo reconoce el equipo encargado de afrontar el mayor reto tecnológico del desarrollo de esta mesa sensorial: el entrenamiento del modelo para que sepa distinguir, solo con verle la cara, la felicidad de quien se relame de gusto, el temor a lo desconocido, la indiferencia, la repulsión...

El desarrollo de esta novedosa mesa ha sido un proceso intenso que ha durado más de un año y que ha involucrado a los expertos de Itainnova Gorka Labata, José Ignacio Calvo, Marcos Caballero, Estela Aguilar y Rafa del Hoyo, como responsable del equipo.

Los retos han sido muchos y diversos. "Desde más técnicos, como encontrar una cámara de vídeo que satisficiera todas nuestras necesidades, hasta lingüísticos, como establecer un marco de comunicación y un lenguaje común entre científicos/as por un lado y cocineros/as por el otro", detallan.

Pero probablemente el mayor reto ha sido el entrenamiento del modelo para que aprendiera a detectar cada una de las emociones. "Aunque existen numerosas bases de datos de caras con sus emociones etiquetadas, ninguna de ellas incluye imágenes de gente comiendo", indican. Por tanto, tuvieron que desarrollar nuestra propia base de datos, "primero realizando grabaciones de vídeo de gente comiendo platos que generasen las distintas emociones –felicidad, sorpresa, asco, tristeza, enfado…– y luego etiquetándolas". Esto es lo que les condujo a tener que comer cosas como las inolvidables guindillas con chucrut remojadas en aceite de coco.

Por suerte, "la parte de entrenar los modelos se nos da bastante mejor y, una vez tuvimos la base de datos, el proceso fue más sencillo", señalan.

¿Cómo se determinan las emociones de los comensales sentados a la mesa sensorial? Lo primero de todo, antes de poder detectar las emociones de cada una de las personas que disfrutan de la experiencia gastronómica, es identificar cuántas son y dónde se ubican sus caras. "Esta primera tarea ya no resulta simple –explican–y para ella utilizamos una serie de algoritmos ya entrenados".

A continuación, hay que determinar la posición de las caras. "Muchas veces las personas miran hacia abajo, hacia el plato, pero este gesto suele asociarse también a la tristeza –advierten–. Debemos saber hacia dónde miran para conocer si la emoción que estamos detectando está relacionada con la experiencia o si es fruto de otra cosa".

Finalmente, "con la imagen de la cara, nuestro algoritmo de redes neuronales (un tipo específico de algoritmos de inteligencia artificial), entrenado específicamente para la tarea, detecta las emociones centrando su atención en marcadores específicos de la cara".

-Ir al suplemento Tercer Milenio

Apúntate y recibe cada semana en tu correo la newsletter de ciencia